在数字化浪潮的推动下,视频内容的创作和编辑正逐步走向智能化和自动化。近日,阿里巴巴通义实验室宣布开源一款名为FunClip的视频自动化剪辑工具,这款工具以其精准和便捷的视频切片功能,为视频编辑领域带来了新的革命性变革。AI旋风深入了解了这款工具的特性和背后的技术支撑,发现其中文语音识别功能尤为突出,成为其引领市场的重要优势。

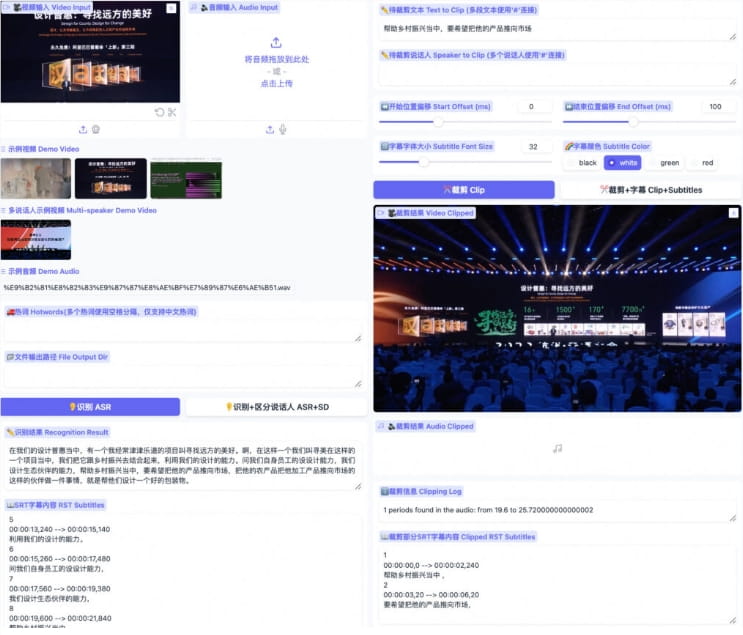

FunClip是一款由阿里巴巴通义实验室倾力打造的视频自动化剪辑工具,其核心功能在于通过自动识别视频中的中文语音内容,允许用户根据语音内容进行精准的视频裁剪。这一功能的实现,不仅大大提高了视频编辑的效率,更为用户带来了全新的创作体验。

在语音识别方面,FunClip采用了阿里巴巴通义实验室的FunASR Paraformer-Large模型。这一模型经过深度学习和优化,具备极高的识别准确率和稳定性,确保了视频剪辑的精准性。用户只需上传视频文件,FunClip便能自动识别其中的中文语音内容,并将其转化为可编辑的文本格式。

在操作简便性方面,FunClip同样表现出色。用户可以根据识别的语音内容,轻松选择需要裁剪的文本片段或说话人。通过简单的拖拽和切割操作,即可实现视频片段的精准裁剪和拼接。此外,FunClip还支持多种视频格式和分辨率的导入和导出,满足了用户在不同场景下的编辑需求。

在上述基本功能的基础上,FunClip有以下特色:

- ?FunClip集成了多种大语言模型调用方式并提供了提示配置接口,尝试通过大语言模型进行视频操作~

- FunClip集成了阿里巴巴的工业级模型Paraformer-Large,是当前识别效果最优的开源中文ASR模型开源,Modelscope下载量1300w+次,并且能够实现标准化的准确预测时间。

- FunClip集成了SeACo-Paraformer的热词定制功能,在ASR过程中可以指定一些实体词、人名等作为热词,提升识别效果。

- FunClip集成了CAM++说话人识别模型,用户可以将自动识别出的说话人ID作为当前目标,将某个说话人的下一步取出来。

- 通过Gradio交互实现上述功能,安装简单使用方便,并且可以在服务端通过浏览器使用宽带服务。

- FunClip支持多段自由剪辑,并且会自动返回全视频SRT字幕、目标段落SRT字幕,使用简单方便。

欢迎使用,欢迎提出关于字幕生成或语音识别的需求与宝贵建议~

![图片[1]-阿里巴巴开源FunClip自动化短视频编辑神器:视频剪辑迎来智能化新纪元,中文语音识别技术大放异彩-得设创意](https://image.deise.cn/deise//2024/05/20240515014741100.jpg)

值得一提的是,FunClip目前主要支持中文语音识别,但阿里巴巴通义实验室表示,未来计划将支持范围扩展至英文等其他语种,以满足全球用户的需求。

FunClip的成功离不开其背后的技术支撑——FunASR工具包。作为一款综合性语音识别工具包,FunASR提供了端到端的语音识别解决方案和一系列开源的、性能优越的预训练模型。这些模型不仅具备高精度和高效能的特点,还具备灵活性和可扩展性,能够轻松应对各种复杂的语音识别场景。

在功能方面,FunASR支持语音识别(ASR)、语音活动检测(VAD)与标点恢复等多种功能。其中,ASR功能提供了非自回归端到端语音识别模型,支持多任务处理;VAD功能则通过预训练模型进行有效的语音活动区段检测;而标点恢复功能则能够自动为识别出的文本添加标点符号,提高文本的可读性。

此外,FunASR还支持模型动态部署与优化。用户可以根据自己的需求对预训练模型进行微调和推理,实现个性化的语音识别服务。同时,FunASR还提供文件转录和实时转录服务,满足不同场景下的语音识别需求。

阿里巴巴通义实验室开源的FunClip视频自动化剪辑工具,无疑为视频编辑领域带来了全新的智能化变革。其中文语音识别功能的引入,不仅提高了视频剪辑的精准性和效率,更为用户带来了全新的创作体验。同时,FunASR工具包的强大功能也为语音识别技术的发展提供了有力支撑。随着人工智能技术的不断进步和应用场景的不断拓展,相信未来会有更多类似的智能化工具出现,为我们的生活带来更多便利和乐趣。